🚀 Das Wichtigste in Kürze

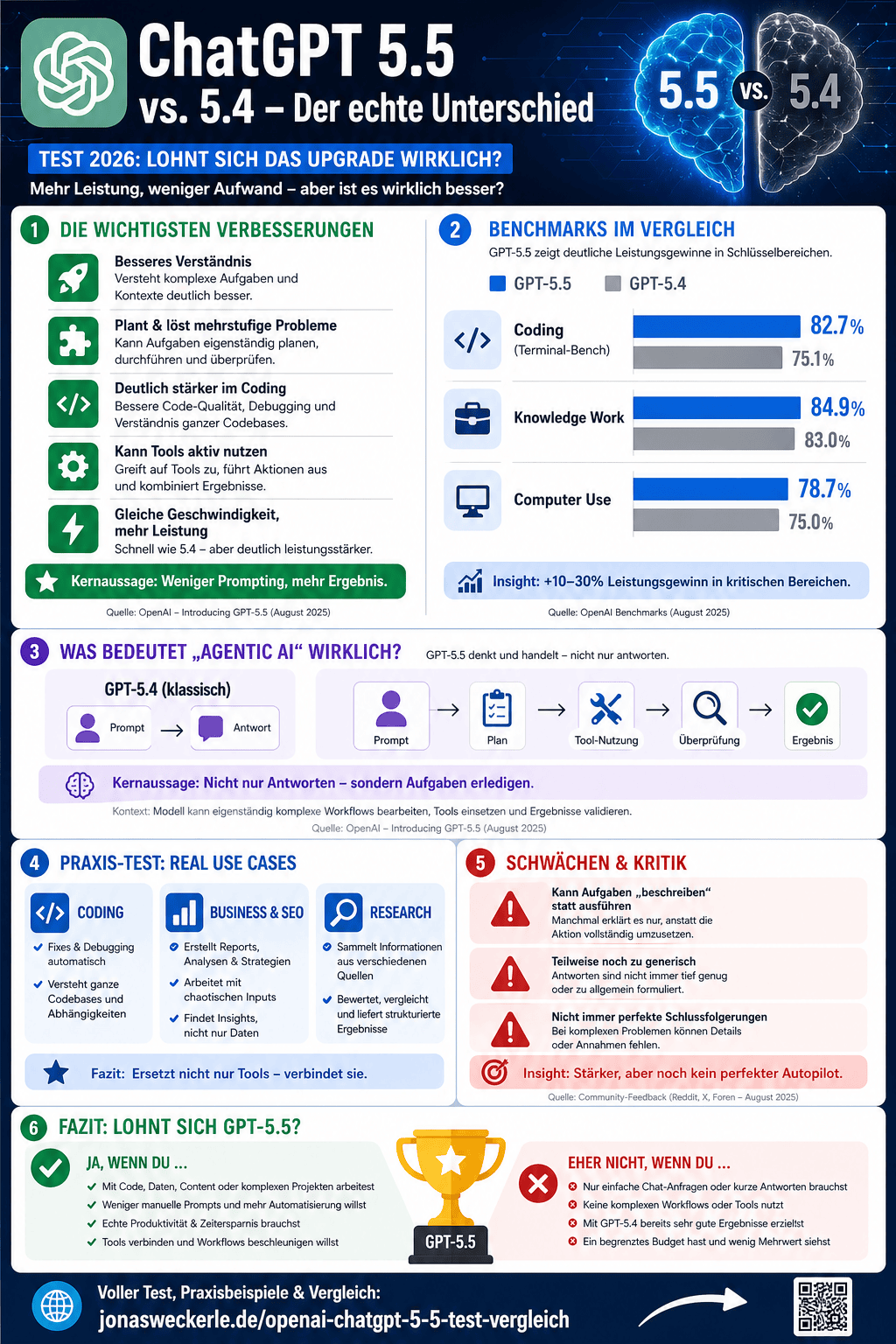

- Fokus auf Agentic Coding: GPT-5.5 ist eine reine Arbeitsmaschine für autonome Programmieraufgaben.

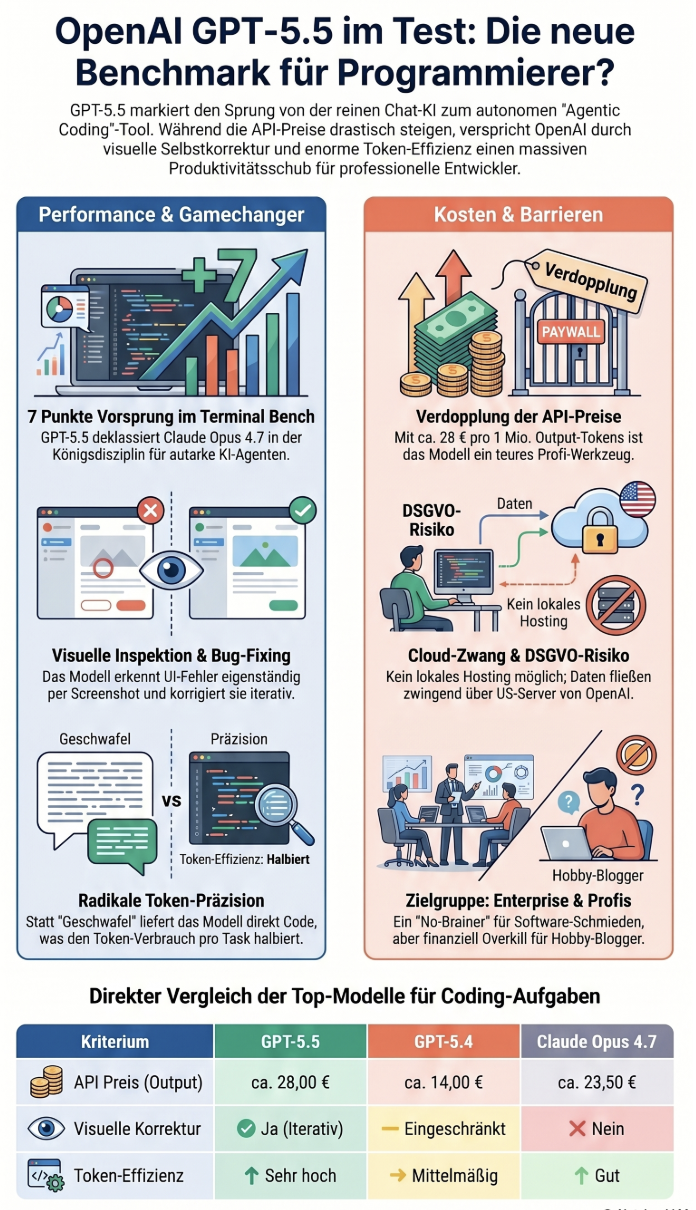

- Schluss mit Geschwafel: Das Modell liefert direkten Code ohne Roman-Erklärungen. Das spart extrem viele Tokens.

- Visuelle Inspektion: GPT-5.5 schaut sich gebaute UIs selbst an und fixt Bugs iterativ. Ein echtes Autopilot-Gefühl.

- Preisschock an der API: ca. 4,70 € (Input) / 28 € (Output) pro 1 Mio. Tokens. Wer hier kein Limit setzt, finanziert Sam Altmans nächste Yacht.

- Verfügbarkeit: Ab sofort im Rollout für ChatGPT Plus/Pro und die hauseigene Coding-Umgebung „Codex“.

Inhalte

Während wir hierzulande noch in Talkshows diskutieren, ob KI nun das Ende der Menschheit oder doch nur das nächste „Neuland“ ist, droppt OpenAI einfach mal so das nächste Frontier-Modell. Du kennst das Problem aus dem Alltag: Du nutzt ein LLM für Code-Projekte, aber das Modell schwafelt wie ein Politiker vor der Wahl. Es schreibt endlose Aufsätze für eine winzige CSS-Änderung und verbrennt dein Token-Budget.

Genau hier setzt GPT-5.5 an. Der Fokus liegt nicht mehr auf nettem Plaudern, sondern auf knallhartem Agentic Coding. Persönlich teste ich solche Modelle im Alltag extrem intensiv – und bei diesem Release hat sich unter der Haube einiges getan.

In diesem Beitrag zeige ich dir völlig pragmatisch, was GPT-5.5 wirklich taugt, ob sich der astronomische Preisaufschlag rechnet und wo das Modell im direkten Duell mit Claude Opus 4.7 steht.

GPT-5.5 vs. GPT-5.4 vs. Claude Opus 4.7

| Kriterium | GPT-5.5 | GPT-5.4 | Claude Opus 4.7 |

|---|---|---|---|

| API Preis (Input/Output) | ca. 4,70 € / 28,00 € | ca. 2,35 € / 14,00 € | ca. 3,75 € / 23,50 € |

| Terminal Bench (Coding) | Führend (+7 Punkte) | Gut | Abgeschlagen |

| Token-Effizienz | Sehr hoch (präzise) | Mittelmäßig (schwafelt) | Gut |

| Visuelle Selbstkorrektur | ✅ Ja (Iterativ) | ❌ Eingeschränkt | ❌ Nein |

Die nackten Zahlen zeigen es: OpenAI lässt sich den Leistungssprung fürstlich bezahlen. Die API-Kosten haben sich im Vergleich zum Vorgänger verdoppelt. Wer hier aus Versehen eine Endlosschleife an die API schickt, kann quasi direkt beim Finanzamt die Privatinsolvenz beantragen. Dafür deklassiert GPT-5.5 im „Terminal Bench“ (der Königsdisziplin für autarke KI-Agenten) den direkten Konkurrenten Claude Opus 4.7 völlig.

Der eigentliche Gamechanger ist jedoch die Token-Effizienz. Wo GPT-5.4 noch knapp 5.000 Output-Tokens brauchte, um ein Problem zu umkreisen, nagelt 5.5 die Lösung mit gut 2.100 Tokens direkt auf den Bildschirm. Das bedeutet für deinen Geldbeutel: Die brutalen API-Kosten relativieren sich im Praxisalltag drastisch, weil das Modell einfach schneller zum Punkt kommt.

Meine Empfehlung zu den Benchmarks: Wer hochkomplexe Agenten oder Enterprise-Software baut, nimmt GPT-5.5. Wer nur ein Python-Skript für seinen Saugroboter schreiben will, bleibt bei den günstigeren Vorgängern.

Quality Check: Die Wahrheit abseits der Labor-Tests

Warum der Hype genau jetzt? Anthropic hat OpenAI in den letzten Monaten bei Coding-Tasks ordentlich ins Schwitzen gebracht. Bisher hatte ich fast ausschließlich Claude Opus im Einsatz. Aber GPT-5.5 bringt ein Feature mit, das mich im Test wirklich abgeholt hat: Visuelle Inspektion.

Statt blind Code an die Wand zu werfen und zu hoffen, dass er klebt, schaut das Modell jetzt selbst hin. Du gibst ihm einen Screenshot, es baut das UI in WebGL, rendert es im Hintergrund und bemerkt eigenständig: „Oh, der Button ist 5 Pixel zu weit links.“ Es fixt den Fehler iterativ, bevor es dir das fertige Ergebnis präsentiert. Das ist endlich echtes Agenten-Verhalten.

Meine Pro & Contra Liste

- ✅ Persönlichkeit: Endlich kein formelles Geschwafel mehr. Du bekommst exakt den Code-Block, nach dem du gefragt hast.

- ✅ Systemverständnis („Sixth Sense“): Es ahnt Fehler in Produktionsumgebungen voraus, selbst ohne direkten Zugriff auf die Live-Datenbank.

- ✅ Latenz: Trotz massiv höherer Komplexität antwortet das Modell genauso schnell wie die 5.4er Version.

- ❌ Kosten-Barriere: Rund 28 € für 1 Mio. Output-Tokens sind für Indie-Hacker und Bastler eine massive Einstiegshürde.

- ❌ Cloud-Zwang: Deine Firmendaten fließen zwingend durch US-Server. Ein DSGVO-Albtraum für den deutschen Mittelstand, sofern du keinen Enterprise-Vertrag abschließt.

Setup & Tech Stack: So kommst du an GPT-5.5

Da GPT-5.5 ein klassisches Closed-Source-Modell ist, entfällt das lustige lokale Gebastel mit Docker, Python-Environments oder Pinokio. Schade für unsere lokalen VRAM-Enthusiasten, aber definitiv ein Segen für deinen Stromzähler zu Hause – bei den deutschen Strompreisen nicht ganz unwichtig.

So startest du sofort:

1. Web-UI: Du benötigst mindestens einen ChatGPT Plus, Pro oder Enterprise Account.

2. Für Entwickler: OpenAI hat das Modell direkt in ihrer hauseigenen IDE-Umgebung „Codex“ freigeschaltet.

3. API-Nutzer: Der Rollout für die API läuft. Sobald du Zugriff hast, kannst du es in Editoren wie Cursor oder Windsurf einbinden. Wichtig: Setze im OpenAI Dashboard sofort ein Hard Cap (Kostenlimit)! Sonst wachst du morgen mit einer sehr bösen Kreditkartenabrechnung auf.

Häufige Fragen (FAQ)

Ist GPT-5.5 wirklich doppelt so teuer?

Auf dem Papier: Ja. Die API-Kosten liegen bei ca. 4,70 € (Input) und satten 28 € (Output). In der Praxis ist das Modell aber so präzise und generiert so wenig Füllwörter, dass du pro Task oft weniger Tokens verbrauchst. Die echten Kosten steigen also moderater an, als die Preisliste vermuten lässt.

Kann ich das Modell lokal hosten?

Nein. GPT-5.5 ist fest an die Cloud-Infrastruktur von OpenAI gebunden. Ohne schnelles Internet bist du aufgeschmissen – was beim Zustand unseres Breitbandausbaus ja fast schon ein Ausschlusskriterium für den ländlichen Raum ist.

Kann ich das Modell lokal hosten?

Nein. GPT-5.5 ist fest an die Cloud-Infrastruktur von OpenAI gebunden. Ohne schnelles Internet bist du aufgeschmissen – was in ländlichen Teilen Deutschlands ja immer noch ein Feature für sich ist.

Wie sieht es mit dem Datenschutz (DSGVO) aus?

Als normaler „Plus“-Nutzer trainiert OpenAI standardmäßig mit deinen Eingaben. Wenn du Firmencode verarbeitest, musst du zwingend die API nutzen (dort wird nicht trainiert) oder einen Enterprise-Vertrag abschließen. Sonst freut sich dein Datenschutzbeauftragter.

Schlägt es Claude Opus im Coding?

Ja, insbesondere wenn es um CLI-Steuerung und autonomes Iterieren geht (Terminal Bench). Claude Opus ist fantastisch im Textverständnis, aber als reiner „Macher“-Agent hat GPT-5.5 aktuell die Nase vorn.

Fazit: Meine Empfehlung

OpenAI hat verstanden, wo das echte Geld liegt: Nicht bei Schülern, die ihre Hausaufgaben generieren, sondern bei Enterprise-Kunden und Software-Schmieden. GPT-5.5 ist eine kompromisslose Arbeitsmaschine. Die Latenz ist genial, das Geschwafel ist weg und die autonome Fehlerbehebung per visuellem Abgleich ist derzeit der Goldstandard.

Meine Empfehlung: Wenn du professionell Software entwickelst, KI-Agenten baust oder produktiven Code verdienst, ist das Update ein No-Brainer. Schwenk sofort um. Bist du nur ein Hobby-Blogger oder bastelst am Wochenende an einer To-Do-Listen-App? Dann spar dir das Geld und bleib bei den günstigeren Modellen.

💡 Meine These zum Schluss: Werden klassische StackOverflow-Copy-Paste-Entwickler durch GPT-5.5 ersetzt? Definitiv. Das Modell übernimmt das Boilerplate-Tippen völlig. Aber: Wer die Architektur im Hintergrund nicht versteht, wird auch mit dem smartesten KI-Agenten irgendwann einen unwartbaren Spaghetti-Code produzieren. Am Ende sitzt das Problem meistens immer noch vor dem Monitor.

Wie siehst du das? Ist der Preis gerechtfertigt oder melkt OpenAI hier nur die Enterprise-Kunden? Schreib es mir unten in die Kommentare!